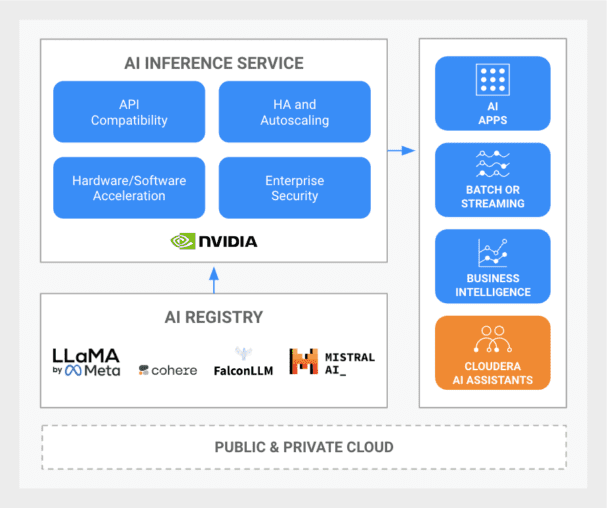

Cloudera introduceert Cloudera AI Inference, aangestuurd door NVIDIA NIM-microservices, onderdeel van het NVIDIA AI Enterprise-platform. Als een van de eerste services voor AI-inferentie die ingebouwde NIM-microservicemogelijkheden biedt, stroomlijnt Cloudera AI Inference de implementatie en het beheer van grootschalige AI-modellen. Daarmee kunnen organisaties het volledige potentieel van hun data benutten, om GenAI van pilotfases naar het operationeel gebruik te brengen.

Gevoelige data beschermen

Recente data van Deloitte onthult dat de grootste barrières voor GenAI-acceptatie compliancerisico’s en governance-zorgen zijn. Toch groeit de acceptatie van GenAI gestaag en heeft ruim twee derde van de ondervraagde organisaties hun GenAI-budgetten in Q3 van dit jaar verhoogd. Om deze zorgen weg te nemen, moeten bedrijven overstappen op het privé uitvoeren van AI-modellen en ‑applicaties, of dit nu on-premises of in openbare clouds is. Deze verandering vereist veilige en schaalbare oplossingen die complexe doe-het-zelfbenaderingen vermijden.

Cloudera AI Inference beschermt gevoelige data tegen lekken naar niet-private, door leveranciers gehoste AI-modelservices, door veilige ontwikkeling en implementatie onder de controle van de eigen organisatie te bieden. De nieuwe service wordt aangestuurd door NVIDIA-technologie en helpt bij het bouwen van vertrouwde data voor vertrouwde AI met hoge verwerkingssnelheden. Dit maakt efficiënte ontwikkeling van AI-gestuurde chatbots, virtuele assistenten en agentische applicaties mogelijk, wat zowel de productiviteit als de groei van organisaties beïnvloedt.

Samenwerking met NVIDIA

De introductie van Cloudera AI Inference volgt kort op de samenwerking van het bedrijf met NVIDIA. Het benadrukt Cloudera’s toewijding aan het stimuleren van AI-innovatie op een cruciaal moment, nu bedrijven zich een weg banen door de complexiteit van digitale transformatie en AI-integratie.

Ontwikkelaars kunnen zakelijke LLM’s bouwen, aanpassen en implementeren, met tot 36x snellere verwerking door NVIDIA Tensor Core GPUs en bijna 4x sneller vergeleken met CPU’s. De gebruikerservaring integreert de UI en API’s rechtstreeks met NVIDIA NIM microservicecontainers, waardoor de noodzaak voor opdrachtregelinterfaces (CLI) en afzonderlijke bewakingssystemen wordt geëlimineerd. De service-integratie met Cloudera’s AI Model Registry verbetert ook de beveiliging en governance door toegangscontroles, te beheren voor zowel model-eindpunten als ‑bewerkingen. Gebruikers profiteren van een uniform platform waar alle modellen, zowel LLM-implementaties als traditionele modellen, worden beheerd met één service.

Tot de belangrijke functies van Cloudera AI Inference behoren:

- Geavanceerde AI-mogelijkheden: gebruik NVIDIA NIM-microservices om open-source LLM’s, waaronder LLama en Mistral, te optimaliseren voor geavanceerde ontwikkelingen in natuurlijke taalverwerking (NLP), computer vision en andere AI-domeinen.

- Hybride cloud en privacy: verwerk workloads on-prem of in de cloud, met VPC-implementaties voor verbeterde beveiliging en naleving van regelgeving.

- Schaalbaarheid en monitoring: vertrouw op automatische schaalbaarheid, hoge beschikbaarheid (HA) en realtime prestatietracking, om problemen te detecteren en te corrigeren en efficiënt resourcebeheer.

- Open API’s en CI/CD-integratie: krijg toegang tot API’s die voldoen aan standaarden voor de implementatie, beheer en monitoring van modellen voor naadloze integratie met CI/CD-pipelines en MLOps-workflows.

- Zakelijk beveiligingsniveau: dwing toegang tot modellen af met functies voor service-accounts, toegangscontrole, lineage en auditing.

- Risicobeheerde implementatie: voer A/B‑testen en canary-uitrol uit voor gecontroleerde modelupdates.

“Bedrijven willen graag investeren in GenAI, maar dat vereist niet alleen schaalbare data, maar ook veilige, compliant en goed beheerde data”, aldus marktanalist Sanjeev Mohan. “Het op grote schaal in gebruik nemen van AI introduceert complexiteit die DIY-benaderingen moeilijk kunnen aanpakken. Cloudera AI Inference biedt uitkomst door geavanceerd databeheer te integreren met de AI-expertise van NVIDIA, waardoor het volledige potentieel van data te ontsluiten is en tegelijkertijd wordt beschermd. Met zakelijke beveiligingsfuncties zoals service-accounts, toegangscontrole en audit kunnen organisaties hun data met vertrouwen beschermen en workloads on-prem of in de cloud uitvoeren. Zo worden AI-modellen efficiënt geïmplementeerd met de benodigde flexibiliteit en governance.”

“Het verheugt ons samen te werken met NVIDIA om Cloudera AI Inference op de markt te brengen, waarmee we een enkel AI/ML-platform bieden dat bijna alle modellen en toepassingen ondersteunt. Vanaf nu kunnen bedrijven zowel krachtige AI-apps maken met onze software, als die AI-apps ook in Cloudera uitvoeren”, zegt Dipto Chakravarty, Chief Product Officer bij Cloudera. “Met de integratie van NVIDIA AI, die slimmere besluitvorming mogelijk maakt door geavanceerde prestaties, innoveert Cloudera voor klanten door vertrouwde AI-apps te bouwen met vertrouwde data op grote schaal.”

“Bedrijven moeten tegenwoordig generatieve AI naadloos integreren met hun bestaande infrastructuur aan data, om de resultaten te stimuleren”, aldus Kari Briski, vice president van AI-software, modellen en services bij NVIDIA. “Door NVIDIA NIM-microservices op te nemen in Cloudera’s AI Inference-platform, stellen we ontwikkelaars in staat om eenvoudig betrouwbare generatieve AI-applicaties te maken en tegelijkertijd een zelfvoorzienend AI-datavliegwiel te faciliteren”.