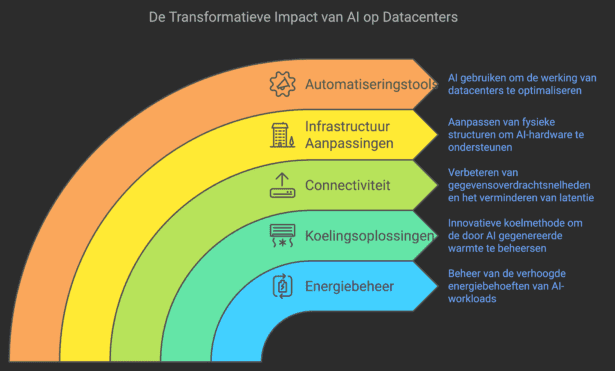

De introductie van kunstmatige intelligentie (AI) heeft de werking van datacenters fundamenteel veranderd. AI, dat inmiddels in vrijwel elke sector zijn weg heeft gevonden, brengt unieke uitdagingen met zich mee op het gebied van energiebeheer, koeling, connectiviteit en ruimtegebruik. In een recent onderzoek analyseert Panduit hoe AI de infrastructuur van datacenters beïnvloedt en welke aanpassingen nodig zijn om deze technologie optimaal te ondersteunen.

Energie-intensieve AI-processen

AI-workloads zoals machine learning en deep learning vragen om enorme rekenkracht, wat leidt tot een forse toename van het energieverbruik. Traditionele datacentertoepassingen draaien vooral op CPU’s, maar AI-processen vereisen GPU’s en TPU’s, die aanzienlijk meer energie verbruiken.

Volgens Panduit kan een enkele CPU ongeveer 100 watt verbruiken, terwijl high-end GPU’s zoals de NVIDIA A100 en H100 tussen de 400 en 800 watt verbruiken. Bij hyperscale datacenters, zoals die van Google en Amazon, kan het totale jaarlijkse energieverbruik hierdoor oplopen tot tientallen megawatt.

Koelingsuitdagingen

Met de stijging in energieverbruik neemt ook de warmteproductie fors toe. Dit stelt datacenters voor nieuwe uitdagingen, aangezien traditionele luchtkoeling zijn limiet bereikt bij rack-dichtheden boven de 20 kilowatt. AI-systemen, met rack-dichtheden die gemakkelijk tussen de 30 en 50 kilowatt liggen, vereisen innovatieve oplossingen.

Vloeistofkoeling wordt gezien als een van de meest efficiënte manieren om deze hitte af te voeren. Een nog geavanceerdere methode, immersion cooling, dompelt hele servers onder in een thermisch geleidende vloeistof. Dit zorgt voor een aanzienlijk betere warmteafvoer in vergelijking met luchtkoeling. Daarnaast investeren datacenters in warmteterugwinningstechnologieën, waarbij overtollige warmte opnieuw wordt gebruikt, bijvoorbeeld voor stadsverwarming.

Snelle gegevensoverdracht en connectiviteit

AI genereert enorme hoeveelheden data die in real-time verwerkt moeten worden. Dit vraagt om ultrasnelle netwerken. Terwijl traditionele datacenters vaak gebruikmaken van Ethernet-netwerken, schakelen AI-datacenters over naar technologieën zoals InfiniBand. Deze netwerken bieden niet alleen een veel hogere bandbreedte, tot wel 800 Gbps, maar ook een aanzienlijk lagere latency.

Ook de vraag naar glasvezelbekabeling groeit, aangezien deze technologie niet alleen toekomstbestendig is, maar ook voldoet aan de hoge eisen van AI-workloads. Goed kabelbeheer blijft hierbij cruciaal om signaalverlies te minimaliseren.

Ruimte- en infrastructuuruitdagingen

AI heeft niet alleen invloed op de technologie, maar ook op de fysieke inrichting van datacenters. De hogere rack-dichtheden en zwaardere hardware vereisen versterkte racks en vloeren. In sommige datacenters wordt apparatuur verspreid over meerdere verdiepingen om de belasting beter te verdelen.

Om flexibel in te spelen op de veranderende eisen van AI, maken datacenters steeds vaker gebruik van modulaire ontwerpen. Deze modulaire eenheden kunnen snel worden aangepast of uitgebreid, wat essentieel is in een omgeving waar technologie zich razendsnel ontwikkelt.

Automatisering en beheertools

AI wordt ook ingezet om de eigen infrastructuur van datacenters efficiënter te maken. Geavanceerde automatiserings- en beheertools gebruiken machine learning om patronen te herkennen in energieverbruik, koelefficiëntie en netwerkprestaties. Hierdoor kunnen operators proactief ingrijpen bij eventuele problemen, wat de uptime van systemen maximaliseert.

Sensoren en slimme analyses helpen bovendien om onderhoud beter te plannen en onverwachte storingen te voorkomen.

Blik op de toekomst

AI blijft zich snel ontwikkelen, en datacenters moeten zich hierop blijven aanpassen. Panduit voorziet dat de scheidslijn tussen AI-modeltraining en ‑inferencing verder vervaagt, wat nieuwe eisen stelt aan de hardware.

Daarnaast ziet Panduit enkele belangrijke trends voor de komende jaren:

• Edge computing: Het verplaatsen van dataverwerking naar de rand van het netwerk om latentie te verlagen.

• Duurzaamheid: De toenemende integratie van hernieuwbare energiebronnen en initiatieven voor koolstofneutraliteit.

• Kwantumcomputing: Hoewel nog in ontwikkeling, kan deze technologie in de toekomst een grote rol spelen in datacenterdesigns. De eerste operationele kwantumcomputers zijn inmiddels al in gebruik, waaronder binnenkort een systeem in Amsterdam.

Conclusie

AI heeft de eisen die aan datacenters worden gesteld ingrijpend veranderd, aldus Panduit. Investeringen in energie-efficiëntie, geavanceerde koelsystemen en netwerkinfrastructuur zijn essentieel om deze veranderingen bij te benen. Door proactief in te spelen op de technologische ontwikkelingen, kunnen datacenters niet alleen de uitdagingen van vandaag aan, maar ook een cruciale rol spelen in de toekomst van AI.

Datacenteroperators die deze dynamiek omarmen, positioneren zichzelf als koplopers in een steeds verder door AI gedreven wereld.