Moderne bedrijven beschikken over een schat aan data, maar toegang tot deze informatie blijft vaak een uitdaging. Traditionele business intelligence (BI) tools schieten tekort in het efficiënt ontsluiten van deze data. Veelal zijn ze te technisch voor doorsnee gebruikers en leveren ze verouderde rapporten. De introductie van conversational AI, met name in de vorm van chatbots, belooft dit landschap te veranderen. Door hun snelle respons en het vermogen om context toe te voegen, bieden AI-chatbots bijna realtime inzichten. Het antwoord op de vraag hierboven is dus hoogstwaarschijnlijk: ja.

Op het recente Evolve-event van Cloudera in New York werd de waarde van conversational AI voor bedrijven benadrukt. Cruciaal is de kwaliteit van de data waarop deze AI wordt getraind. Alleen door onderscheid te maken tussen enerzijds correcte en kwalitatief hoogwaardige data en anderzijds data waarvan de kwaliteit onduidelijk of laag is, kunnen AI-systemen effectief worden getraind voor betrouwbare resultaten.

Het is van belang dat AI-modellen worden getraind met duidelijk gedefinieerde en kwalitatieve data die voldoet aan de eisen van de organisatie. Dit kan betekenen dat datasets beperkt blijven, wat weer ten goede komt aan de benodigde IT-resources. Dit is vooral belangrijk in de beginfase, waarbij gebruikers nog moeten leren hoe ze het beste vragen kunnen stellen aan AI-chatbots.

De praktijk van Conversational AI

Met geavanceerde AI kunnen gebruikers complexe vragen stellen aan de chatbot. De opkomst van Large Language Models (LLM) zoals ChatGPT heeft de interesse in dergelijke technologieën enorm verhoogd. Bedrijven experimenteren hiermee om hun interne processen en klantinteracties te verbeteren.

Tijdens het Cloudera-event werd duidelijk dat de mate waarin organisaties deze technologieën benutten sterk varieert. Interessant is dat niet zozeer de techniek, maar vooral de houding van eindgebruikers tegenover AI een sleutelrol speelt. Aspecten als veranderingsangst, zorgen over baanverlies door AI, en twijfels over de effectiviteit van AI waren prominente thema’s.

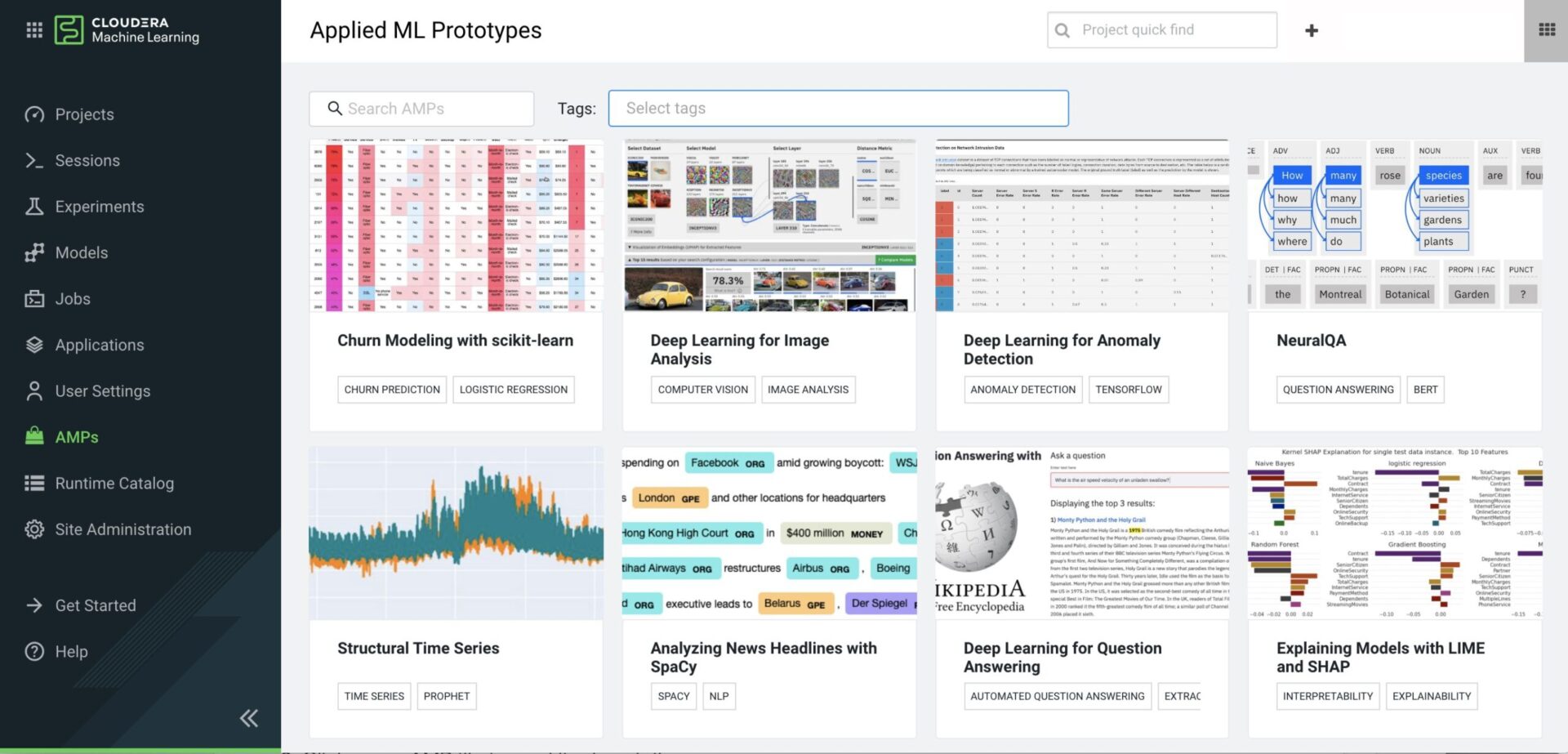

Enterprises hebben specifieke eisen die verder gaan dan standaardtoepassingen, met name op het gebied van privacy. De terughoudendheid om interne kennis te delen met externe providers is groot. Open source-modellen bieden hier waarschijnlijk een oplossing. Deze kunnen intern geïmplementeerd worden, hoewel niet elke IT- en business-afdeling hier technisch toe in staat is. Gespecialiseerde data science en AI-bedrijven bieden hier steeds meer oplossingen voor. Zo introduceerde Cloudera een ‘Applied Machine Learning Prototype’ (AMP), een LLM Chatbot verrijkt met enterprise-data, volledig gebaseerd op open source-technologie.

Applied Machine Learning Prototypes

AMPs zijn kant-en-klare, end-to-end machine learning-projecten, ontworpen om specifieke bedrijfscases te ondersteunen. Bij Cloudera bijvoorbeeld, kan men met één klik een ML-project selecteren en implementeren uit de AMP-catalogus.

De implementatie van een AMP omvat drie stappen:

1. Resource checks: het verifiëren van beschikbare IT-middelen.

2. Project setup: het installeren van afhankelijkheden en downloaden van het model.

3. ETL-proces: het vullen van een vector database met eigen data voor training.

De kwaliteit van de chatbot-reacties is afhankelijk van de kwaliteit van de data in de vector database. Het is essentieel om de gebruikte kennisbasis zorgvuldig te organiseren en op te schonen.

AMP in actie

Het AMP-proces gebruikt Retrieval-Augmented Generation (RAG) voor het genereren van nauwkeurige antwoorden. Eerst wordt context uit een kennisbank toegevoegd aan de vraag van de gebruiker. Vervolgens wordt een verbeterde prompt ingediend bij de LLM om het antwoord te genereren. Met andere woorden: de oorspronkelijke vraag van de gebruiker plus de gevonden context worden gezamenlijk als een nieuwe prompt bij het model ingegeven. Het resultaat wordt gepresenteerd via een webapplicatie, waardoor gebruikers gedetailleerde en accurate antwoorden krijgen.

De ervaring van Cloudera met dit proces laat zien dat het AMP-prototype contextueel relevante en goed geïnformeerde reacties genereert, wat de gebruikerservaring aanzienlijk verbetert. Conversational AI chatbots bieden dan ook veel potentieel voor het efficiënt ontsluiten van interne data in bedrijven. Het Evolve-event toonde aan dat er een grote interesse is in het gebruik van deze technologie voor een vraag- en antwoordgestuurde benadering. Verschillende organisaties hebben al succes geboekt met AMP’s, zo bleek tijdens Evolve, variërend van autofabrikanten tot farmaceutische bedrijven en banken.